IA illusion d’avenir.

Ce n’est pas seulement le titre du livre d’Emmanuelle Darles, docteure en informatique et chercheuse.

C’est un avertissement.

Dans une émission dense sur BTLV avec Bob Bellanca et François Demierre, elle démonte patiemment le storytelling radieux de l’intelligence artificielle : progrès, confort, gain de temps, créativité augmentée… Oui, mais à quel prix, et pour qui ?

Derrière les promesses de rapidité et d’efficacité, IA illusion d’avenir montre une autre réalité :

celle d’un monde où notre pensée, notre travail, notre santé et même notre liberté deviennent l’objet d’un pilotage algorithmique, opaque et idéologiquement orienté.

Cet article revient sur les points clés de l’entretien vidéo, et explique pourquoi lire ce livre maintenant est un geste de lucidité – et de défense.

Une révolution technique… mais surtout un basculement anthropologique

Les médias présentent souvent l’IA comme un simple changement d’outils.

Pour Emmanuelle Darles, c’est une erreur fondamentale.

Oui, il y a eu une révolution technique, qu’elle décrit très clairement :

- montée en puissance du cloud computing,

- explosion des GPU capables de traiter des masses de données colossales,

- industrialisation des IA génératives (dont les modèles étaient autrefois confinés aux laboratoires de Google et consorts).

Mais le cœur de son propos est ailleurs :

l’IA transforme notre rapport à la connaissance, au travail, au jugement et à nous-mêmes.

Chaque fois que nous laissons une IA :

- rédiger à notre place,

- réfléchir à notre place,

- décider pour nous ce qui est pertinent ou vrai,

nous nous engageons dans un mouvement sourd de désapprentissage.

Notre cerveau travaille moins, notre esprit critique se relâche, et nous glissons vers une dépendance cognitive douce, confortable, presque agréable… mais dangereuse.

Sous le vernis high-tech: un nouvel esclavagisme numérique

On présente l’IA comme une prouesse immatérielle, presque magique.

IA illusion d’avenir rappelle un fait beaucoup plus trivial : derrière les interfaces lisses, il y a des corps, des vies, des heures de travail invisibles.

Emmanuelle Darles évoque ces « petites mains de l’IA » :

- des travailleurs au Kenya, en Inde, aux Philippines,

- payés moins de deux dollars de l’heure,

- chargés d’étiqueter des données, de filtrer des images, de nettoyer des contenus traumatiques.

Nous applaudissons l’IA qui « comprend les émotions », « détecte la haine » ou « modère les contenus ».

Mais ce vernis de sophistication repose sur une réalité brutale: un nouvel esclavage numérique, parfaitement adapté au XXIᵉ siècle, silencieux, externalisé, presque invisible.

Pendant qu’on nous promet une économie plus fluide, plus efficace, plus « intelligente », des milliers de personnes s’épuisent à nourrir les modèles en données, dans une zone grise du droit social.

L’IA n’est pas neutre : elle porte des biais, une vision du monde, un pouvoir

Une des illusions les plus dangereuses est celle de la neutralité technique :

« ce ne sont que des algorithmes, tout dépend de l’usage qu’on en fait ».

IA illusion d’avenir montre que ce discours est insoutenable.

Biais idéologiques et pensée prédictive

Les modèles d’IA sont entraînés sur des corpus massifs, produits dans un contexte culturel précis.

Résultat : ils reproduisent et amplifient des biais idéologiques.

Emmanuelle Darles rappelle que :

- des études ont déjà mis au jour des biais massifs dans les systèmes de scoring judiciaire (comme COMPAS, utilisé aux États-Unis pour évaluer un « risque de récidive »),

- les IA conversationnelles reflètent majoritairement des valeurs occidentales, progressistes, technophiles,

- les algorithmes apprennent à détecter nos émotions… pour mieux ajuster leurs réponses et maximiser notre engagement.

Ce n’est plus seulement de l’assistance :

c’est un début de pilotage de la perception, où l’on vous montre ce qui vous confirmera, vous apaisera ou vous stimulera.

Petit à petit, nous glissons vers une pensée prédictive: nos réactions sont anticipées, modélisées, exploitées.

La liberté devient optionnelle.

La dilution organisée de la responsabilité

Autre point crucial souligné dans l’interview: la question de la responsabilité.

Quand l’IA se trompe, qui est responsable?

- le médecin qui s’est appuyé sur un logiciel d’aide à la décision?

- le juge qui a suivi un score de risque?

- l’entreprise qui a « externalisé » le tri des candidatures à un algorithme?

- l’éditeur qui a fourni le modèle?

Dans la pratique, chacun peut dire: « Ce n’est pas moi, c’est le système. »

IA illusion d’avenir montre que plus nous confions de décisions à des systèmes opaques, plus la chaîne de responsabilité se dissout.

Et dans une société sans responsable clairement identifiable, l’injustice peut prospérer en toute tranquillité.

Éducation, santé, justice : trois terrains d’expérimentation massive

L’entretien BTLV ci-dessous est riche en exemples concrets.

Loin des scénarios de science-fiction, Emmanuelle Darles décrit ce qui se passe déjà, ici et maintenant.

École: de la dissertation à la fabrique du « crétin assisté »

Comme enseignante-chercheuse, elle le voit tous les jours:

- copies manifestement rédigées par IA,

- projets financés rédigés par IA,

- étudiants incapables d’expliquer le code ou le texte qu’ils ont remis.

Le problème n’est pas seulement moral (« tricher ou non »).

Le vrai danger est ailleurs: on n’apprend plus.

L’IA devient une béquille permanente.

On n’a plus besoin de structurer une pensée, de chercher dans les sources, de faire l’effort de formuler. On « génère ».

Et à force de déléguer, on finit par ne plus savoir faire.

Le risque?

Une génération suréquipée d’outils, mais sous-équipée en capacité de jugement, d’analyse, de profondeur.

Médecine : quand l’IA voit tout… sauf la personne

En santé, le tableau est plus nuancé.

Oui, comme le rappelle Emmanuelle Darles, l’IA permet:

- de détecter des tumeurs ou anomalies sur des images médicales avec une précision souvent supérieure à l’œil humain,

- d’identifier des patterns invisibles dans des millions de dossiers.

Mais:

- les modèles sont entraînés sur des corps « normalisés »: ce qui sort des normes peut être mal vu ou pas vu,

- les faux positifs et faux négatifs existent, et ils ont des conséquences très concrètes,

- une médecine qui prédit statistiquement votre futur (risque de cancer, d’infarctus, etc.) peut installer une anxiété de fond, permanente.

Là encore, le livre IA illusion d’avenir insiste: tout dépend de la place que nous acceptons de donner à l’outil.

Comme aide puissante à la décision ?

Ou comme oracle indiscutable qui dicte la conduite à tenir ?

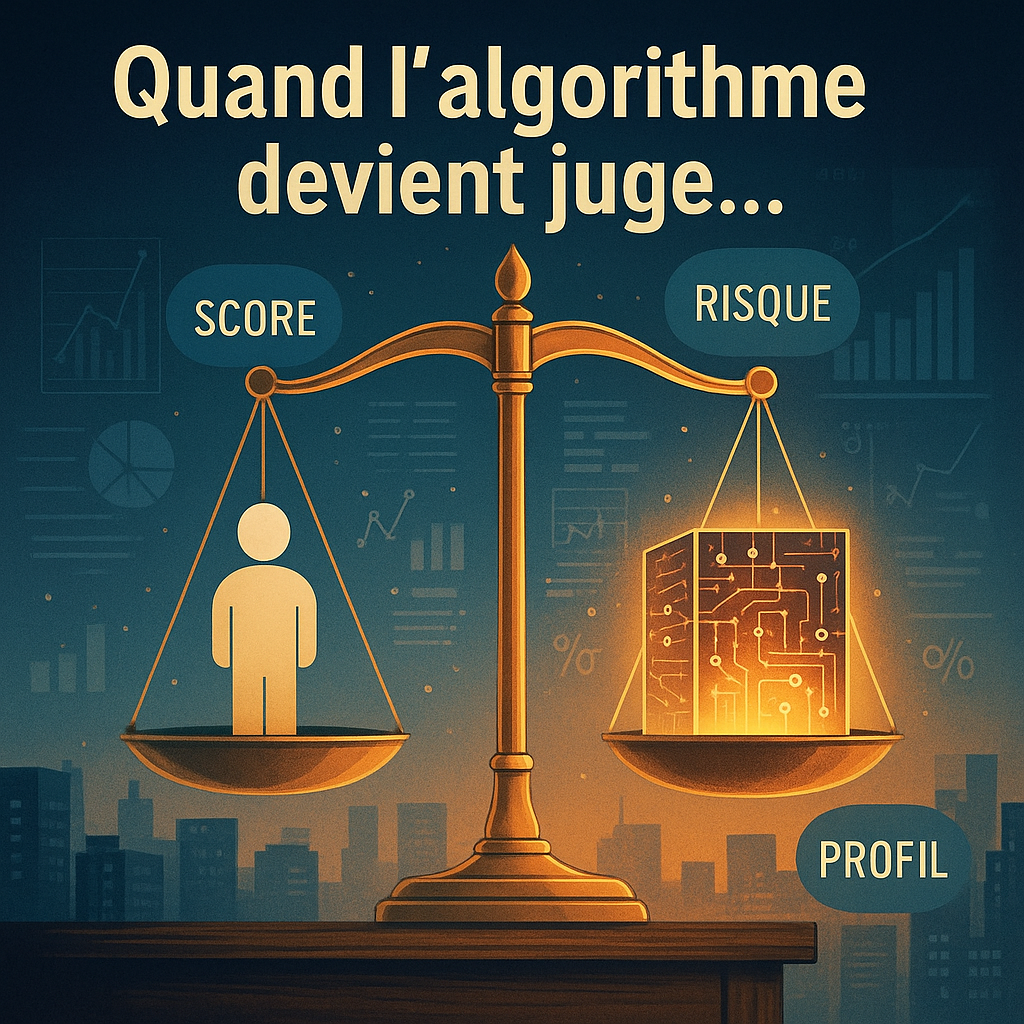

Justice: quand votre avenir tient à un score

Dans le champ judiciaire, l’exemple du système COMPAS est emblématique:

- on y utilise un score algorithmique pour estimer le « risque de récidive » d’un individu,

- des enquêtes ont montré que ces scores sont biaisés, notamment au détriment de certaines populations.

Le danger est évident:

un algorithme, présenté comme scientifique et neutre, vient habiller de chiffres des décisions profondément politiques et morales.

La question n’est plus seulement : « La personne a-t-elle commis un délit ? »

mais : « Le modèle estime-t-il qu’elle pourrait, un jour, en commettre un autre ? »

IA illusion d’avenir déplie ce glissement vers une société de scoring permanent, où chaque individu devient un profil calculé, pondéré, noté.

La question centrale d’Emmanuelle Darles: qu’acceptons-nous de déléguer ?

Tout au long de l’entretien, une idée revient comme un fil rouge.

La question essentielle n’est pas :

« Jusqu’où l’IA peut-elle aller ? »

La question est:

« Qu’acceptons-nous, nous, de déléguer ou non à des intelligences artificielles ? »

C’est là que le livre IA illusion d’avenir prend toute sa force.

Il ne se contente pas de décrire la technique.

Il pose des questions politiques, éthiques, sociales :

- Choisissons-nous de laisser l’IA écrire nos lois implicites, nos normes invisibles ?

- Acceptons-nous qu’elle soit le nouvel arbitre de ce qui est acceptable ou non dans le débat public ?

- Voulons-nous que notre futur soit formaté par quelques plateformes privées qui contrôlent l’accès aux données, aux modèles, aux infrastructures ?

Emmanuelle Darles appelle cela la vigilance active :

ni naïveté technophile, ni catastrophisme paralysant.

Mais un refus net de subir, sans discussion, des transformations qui engagent notre avenir collectif.

La vidéo à voir absolument : l’échange BTLV avec Emmanuelle Darles

Pour entrer dans la pensée d’Emmanuelle Darles, rien ne remplace l’écoute de ses mots, de son ton, de ses nuances.

👉 Regardez l’entretien complet sur BTLV:

Vous y retrouverez:

- la complicité et les questions sans filtre de Bob Bellanca,

- le regard croisé de François Demier,

- et la clarté pédagogique d’Emmanuelle Darles, capable de rendre compréhensibles des enjeux extrêmement techniques.

👉 Après avoir vu cette vidéo, voici la suite logique, si vous voulez faire votre part de colibri…

Découvrir le livre « IA illusion d’avenir »

Pour aller plus loin, lire, annoter, revenir en arrière, relire certains passages, il vous faut le texte de référence.

👉 Découvrir le livre « IA illusion d’avenir: Les dangers de l’intelligence artificielle » d’Emmanuelle Darles

ou ajoutez le livre directement dans votre panier sur notre boutique:

(Profitez de 5% de réduction supplémentaire avec le code Promo PAGE5)

Cliquez sur le bouton, entrez le code dans le champ « BONS »

Ce livre prolonge l’émission en:

- structurant l’analyse (technique, sociale, géopolitique, juridique),

- détaillant les coulisses de l’IA (travailleurs cachés, données, infrastructures),

- décortiquant ses effets sur l’école, le travail, la démocratie, la santé,

- se concluant par un manifeste pour reprendre la main, collectivement.

Pourquoi lire « IA illusion d’avenir » maintenant (et pas « plus tard »)

On pourrait être tenté de remettre cette lecture à plus tard.

Après tout, l’IA est déjà partout: dans nos téléphones, nos moteurs de recherche, nos plateformes de streaming.

L’illusion la plus confortable est de se dire: « De toute façon, c’est lancé, on n’y peut rien. »

C’est précisément contre cette fatalité qu’écrit Emmanuelle Darles.

Lire IA illusion d’avenir maintenant, c’est:

- comprendre les mécanismes pendant qu’il est encore temps de les discuter,

- se doter d’arguments solides pour alimenter des débats dans sa famille, son entreprise, ses réseaux,

- sortir du face-à-face stérile « techno-fan / techno-sceptique »,

- entrer dans une démarche de souveraineté intellectuelle : décider soi-même de ce que l’on accepte et de ce que l’on refuse.

C’est aussi, très simplement, refuser de n’être qu’un « utilisateur » parmi d’autres, et choisir d’être un citoyen informé dans un monde numérique.

Rester humain dans un monde d’algorithmes

IA illusion d’avenir n’est pas un livre de désespoir.

C’est un livre d’alerte, mais aussi de possibles.

Rester humain dans un monde saturé d’IA, c’est par exemple :

- continuer à lire des livres, des auteurs, des voix singulières, pas seulement des synthèses générées,

- croiser plusieurs sources d’information au lieu de prendre la réponse d’un seul modèle pour parole d’évangile,

- réapprendre à discuter sans intermédiaire, en vrai, avec des désaccords, des silences, des nuances,

- accueillir la technique comme un outil puissant… tout en gardant la main sur les décisions ultimes.

Et surtout, se poser régulièrement cette question simple:

« Là, maintenant, qu’est-ce que je choisis encore de faire par moi-même?

Et qu’est-ce que je suis en train de laisser faire par une IA… sans même m’en rendre compte? »

En ce sens, l’expression IA illusion d’avenir est double:

- illusion de croire que la technologie nous sauvera de tout,

- illusion de croire que nous n’avons plus aucun pouvoir.

Regarder l’interview, lire le livre, en parler autour de vous, c’est déjà commencer à percer cette illusion.

Et vous, où en êtes-vous avec l’intelligence artificielle?

Est-ce que vous l’utilisez déjà au quotidien, avec confiance… ou avec malaise?

Avez-vous le sentiment qu’elle vous libère du temps, ou qu’elle commence à penser un peu trop à votre place?

Dites-le nous en commentaire: vos questions, vos expériences et vos inquiétudes sont précieuses pour nourrir ce débat, et pour décider ensemble si cela doit rester un simple outil, ou devenir un sujet de résistance active.